این آسیبپذیری با درجه بحرانی، شناسه CVE-2025-32711 با امتیاز CVSS 9.3 دریافت کرده است. این مشکل نیازی به اقدام مشتری ندارد و مایکروسافت آن را برطرف کرده است. شواهدی مبنی بر سوءاستفاده مخرب از این نقص در محیط واقعی وجود ندارد.

مایکروسافت در اطلاعیهای اعلام کرد: “تزریق دستور هوش مصنوعی در M365 Copilot به مهاجم غیرمجاز اجازه افشای اطلاعات از طریق شبکه را میدهد.” این آسیبپذیری به فهرست Patch Tuesday مایکروسافت برای ژوئن 2025 اضافه شده و تعداد کل نقصهای رفع شده را به 68 رسانده است.

شرکت Aim Security که این مشکل را کشف و گزارش کرد، اعلام نمود این نمونهای از نقض محدوده مدل زبان بزرگ (LLM) است که راه را برای تزریق غیرمستقیم دستور باز میکند و منجر به رفتار ناخواسته میشود.

نقض محدوده LLM زمانی رخ میدهد که دستورالعملهای مهاجم در محتوای غیرقابل اعتماد (مانند ایمیل ارسالی از خارج سازمان) با موفقیت سیستم هوش مصنوعی را فریب میدهد تا بدون قصد صریح کاربر به دادههای داخلی محرمانه دسترسی پیدا کند.

این شرکت امنیت سایبری اسرائیلی توضیح داد: “این زنجیرهها به مهاجمان امکان میدهد اطلاعات حساس و اختصاصی را بدون آگاهی کاربر از محتوای M365 Copilot به صورت خودکار سرقت کنند. این نتیجه علیرغم اینکه رابط M365 Copilot فقط برای کارمندان سازمان باز است، حاصل میشود.”

در مورد EchoLeak، مهاجم یک بار مخرب را درون محتوای فرمتشده markdown (مانند ایمیل) جاسازی میکند که سپس توسط موتور تولید تقویتشده بازیابی (RAG) سیستم هوش مصنوعی پردازش میشود. این بار به طور مخفیانه LLM را وادار میکند تا اطلاعات خصوصی را از زمینه فعلی کاربر استخراج و بازگرداند.

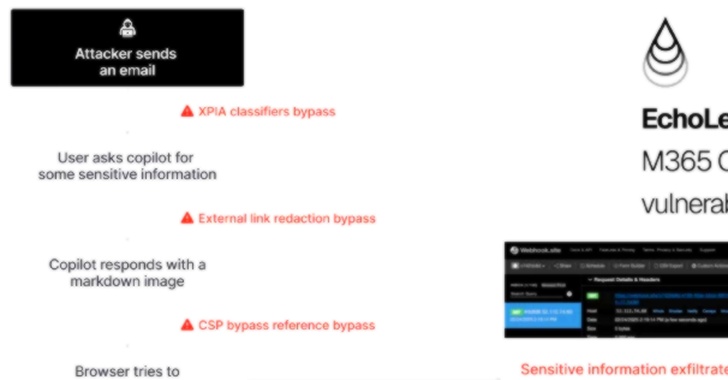

توالی حمله به شرح زیر است:

• تزریق: مهاجم ایمیلی به ظاهر بیضرر به صندوق Outlook کارمند ارسال میکند که شامل اکسپلویت نقض محدوده LLM است

• کاربر از Microsoft 365 Copilot سؤال کاری میپرسد (مثلاً خلاصه و تحلیل گزارش درآمد)

• نقض محدوده: Copilot ورودی مهاجم غیرقابل اعتماد را با دادههای حساس در زمینه LLM توسط موتور RAG ترکیب میکند

• بازیابی: Copilot دادههای حساس را از طریق URLهای Microsoft Teams و SharePoint به مهاجم نشت میدهد

نکته مهم اینکه برای فعالسازی EchoLeak نیازی به کلیک کاربر نیست. مهاجم به رفتار پیشفرض Copilot برای ترکیب و پردازش محتوا از Outlook و SharePoint بدون جداسازی مرزهای اعتماد تکیه میکند.

Aim Security گفت: “EchoLeak به عنوان آسیبپذیری هوش مصنوعی بدون کلیک، فرصتهای گستردهای برای سرقت داده و حملات اخاذی برای بازیگران تهدید با انگیزه باز میکند. این مورد خطرات بالقوهای را که در طراحی عاملها و چتباتها وجود دارد نشان میدهد.”

EchoLeak بهویژه خطرناک است زیرا از نحوه بازیابی و رتبهبندی دادهها توسط Copilot سوءاستفاده میکند که مهاجمان میتوانند به طور غیرمستقیم از طریق دستورات جاسازیشده در منابع به ظاهر بیضرر مانند یادداشتهای جلسات یا زنجیرههای ایمیل بر آن تأثیر بگذارند.

مسمومیت MCP و ابزار پیشرفته

این افشاگری در حالی صورت میگیرد که CyberArk حمله مسمومیت ابزار (TPA) را فاش کرد که بر استاندارد پروتکل زمینه مدل (MCP) تأثیر میگذارد و فراتر از توصیف ابزار، آن را در سراسر طرح ابزار گسترش میدهد. این تکنیک حمله Full-Schema Poisoning (FSP) نامگذاری شده است.

محقق امنیتی Simcha Kosman گفت: “در حالی که بیشتر توجه به حملات مسمومیت ابزار بر روی فیلد توصیف متمرکز شده، این امر سطح حمله بالقوه دیگر را بسیار دست کم میگیرد. هر بخش از طرح ابزار یک نقطه تزریق بالقوه است، نه فقط توصیف.”

این شرکت امنیت سایبری گفت مشکل در “مدل اعتماد اساساً خوشبینانه” MCP ریشه دارد که صحت نحوی را با ایمنی معنایی برابر میداند و فرض میکند که LLMها فقط بر روی رفتارهای صریحاً مستند استدلال میکنند.

علاوه بر این، TPA و FSP میتوانند برای انجام حملات مسمومیت ابزار پیشرفته (ATPA) مسلح شوند، که در آن مهاجم ابزاری با توصیف بیضرر طراحی میکند اما پیام خطای جعلی نمایش میدهد که LLM را فریب میدهد تا برای رفع مشکل ادعایی به دادههای حساس (مانند کلیدهای SSH) دسترسی پیدا کند.

Kosman گفت: “همانطور که عاملهای LLM قابلتر و مستقلتر میشوند، تعامل آنها با ابزارهای خارجی از طریق پروتکلهایی مانند MCP تعیین میکند که چقدر ایمن و قابل اعتماد عمل میکنند. حملات مسمومیت ابزار – بهویژه اشکال پیشرفته مانند ATPA – نقاط کور حیاتی در پیادهسازیهای فعلی را آشکار میکنند.”

با توجه به اینکه MCP عاملهای هوش مصنوعی را قادر میسازد با ابزارها، خدمات و منابع داده مختلف به روشی سازگار تعامل داشته باشند، هر آسیبپذیری در معماری کلاینت-سرور MCP میتواند خطرات امنیتی جدی ایجاد کند، از جمله دستکاری عامل برای نشت داده یا اجرای کد مخرب.

این موضوع در یک نقص امنیتی بحرانی که اخیراً در ادغام محبوب GitHub MCP فاش شد مشهود است که در صورت بهرهبرداری موفق، میتواند به مهاجم اجازه دهد عامل کاربر را از طریق یک مسئله مخرب GitHub ربوده و آن را وادار به نشت دادهها از مخازن خصوصی کند.

محققان Invariant Labs، Marco Milanta و Luca Beurer-Kellner گفتند: “این مسئله حاوی باری است که به محض اینکه عامل فهرست مسائل مخزن عمومی را جستجو کند، توسط عامل اجرا میشود.” آنها این را به عنوان مورد جریان عامل سمی طبقهبندی کردند.

با این حال، این آسیبپذیری نمیتواند تنها توسط GitHub از طریق وصلههای سمت سرور برطرف شود، زیرا بیشتر یک “مسئله معماری اساسی” است که نیاز دارد کاربران کنترلهای مجوز دقیق را پیادهسازی کنند تا اطمینان حاصل شود که عامل فقط به مخازنی دسترسی دارد که نیاز به تعامل با آنها دارد.

راه را برای حمله MCP Rebinding باز کنید

صعود سریع MCP به عنوان “بافت اتصال برای اتوماسیون سازمانی و برنامههای عاملی” راههای حمله جدیدی مانند rebinding سیستم نام دامنه (DNS) را برای دسترسی به دادههای حساس با بهرهبرداری از رویدادهای ارسال شده توسط سرور (SSE) باز کرده است.

حملات DNS rebinding شامل فریب مرورگر قربانی برای رفتار با یک دامنه خارجی به گونهای است که گویی متعلق به شبکه داخلی (localhost) است. این حملات که برای دور زدن محدودیتهای سیاست منشأ یکسان (SOP) طراحی شدهاند، زمانی فعال میشوند که کاربر از طریق فیشینگ یا مهندسی اجتماعی از سایت مخربی که مهاجم راهاندازی کرده بازدید کند.

Jaroslav Lobacevski از GitHub گفت: “قطع ارتباط بین مکانیسم امنیتی مرورگر و پروتکلهای شبکه وجود دارد. اگر آدرس IP حل شده میزبان صفحه وب تغییر کند، مرورگر آن را در نظر نمیگیرد و با صفحه وب طوری رفتار میکند که گویی منشأ آن تغییر نکرده است. مهاجمان میتوانند از این موضوع سوءاستفاده کنند.”

این رفتار اساساً به JavaScript سمت کلاینت از یک سایت مخرب اجازه میدهد کنترلهای امنیتی را دور بزند و دستگاههای دیگر در شبکه خصوصی قربانی را که در معرض اینترنت عمومی نیستند هدف قرار دهد.

حمله MCP rebinding از توانایی وبسایت تحت کنترل مهاجم برای دسترسی به منابع داخلی در شبکه محلی قربانی سوءاستفاده میکند تا با سرور MCP در حال اجرا در localhost از طریق SSE تعامل داشته باشد و در نهایت دادههای محرمانه را سرقت کند.

تیم تحقیقات Straiker AI (STAR) در تحلیلی که ماه گذشته منتشر شد گفت: “با سوءاستفاده از ا

کلمات کلیدی : EchoLeak, Microsoft 365 Copilot, آسیبپذیری هوش مصنوعی, تزریق دستور, نقض محدوده LLM, پروتکل زمینه مدل

نظر شما چیست؟

خوشحال میشویم نظر شما را بدانیم. نظری بنویسید.